中国青年报客户端讯(中青报·中青网记者 赵婷婷)在伊朗和以色列,随时会被导弹袭击的威胁笼罩着当地社区。对当地居民来说,他们不止要担忧自身安全,还需警惕错误信息导致的不安。

“生成式人工智能(AI)工具不断提高图像逼真度,这一工具被用于传播错误信息、制造混乱,并不令人意外。”美国加州大学伯克利分校教授哈尼·法里德告诉法国24电视台。

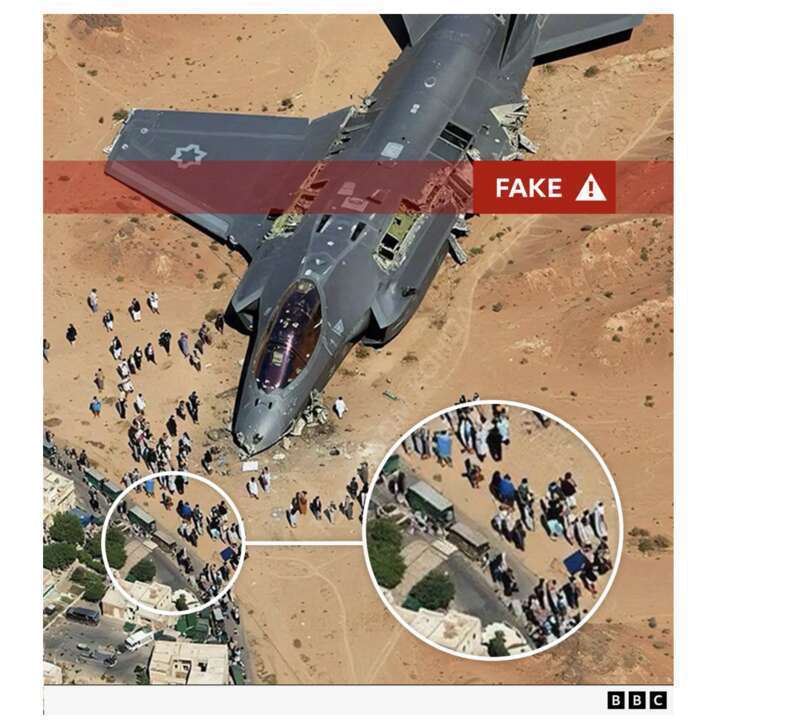

英国广播公司发现,以伊冲突期间,一张显示“一架喷气式飞机在伊朗沙漠地区被击落”的照片在社交平台上大量传播。不过,它由AI伪造的痕迹非常明显。仔细观察可以看出,喷气机周围的民众与附近的车辆大小相同,沙地上也没有被撞击的痕迹。

英国路透社、美联社和美国彭博社等多家媒体观察到,从巴以冲突、以伊冲突到美国洛杉矶地区的抗议活动,社交平台上围绕这些事件涌现出大量传播虚假信息的账号。

有专家告诉法新社,冲突期间虚假信息激增,凸显出社会对更强大的检测工具有迫切需求。然而,降低内容审核力度、减少对事实核查人员的依赖成为主流科技平台的趋势,这在很大程度上削弱了信息监管的保障机制。

卡塔尔半岛电视台报道称,5月,谷歌公司发布了Veo 3模型,这是一款能根据文字提示生成8秒视频的工具。半岛电视台工作人员使用后发现,该工具生成的音视频效果逼真,人们很难将其与真实内容区别开。

Veo 3的出现加剧了人们对如何辨别真实与虚构的担忧。有专家直言,在还没有明确的用户保护政策时便推出这款工具,是鲁莽的行为。

“他们(谷歌公司)不关心用户,只关心自己闪亮的新技术。”深度伪造检测公司Polyguard的首席执行官约书亚·麦肯提告诉半岛电视台,谷歌仓促地将产品推向市场,原因是不甘落后于OpenAI、微软等竞争对手。美国斯沃斯莫尔学院计算机科学助理教授苏克里特·文卡塔吉里指出,许多科技公司陷入“奇怪的困境”,担心自己如果不开发生成式AI工具就会被视作技术落后,导致股价下跌,这使得它们“把利润或盈利承诺看得比安全更重要”。文卡塔吉里强调,企业有责任确保其产品的安全性。

当深度伪造的内容日益普遍、传播速度不断加快,掌握辨识真伪的能力变得至关重要。

法里德分享了一个甄别深度伪造视频的技巧。以Veo 3模型为例,它生成的视频长度通常为8秒,或是由8秒的片段组合而成。“8秒的时长限制无法直接证明视频是伪造的,但可以提醒我们在转发之前核查信息。”

谈及如何避免成为AI伪造视频的受害者,法里德强调:“不要再从社交媒体上获取新闻了,尤其是突发事件。”

来源:中国青年报客户端

诚信双盈提示:文章来自网络,不代表本站观点。